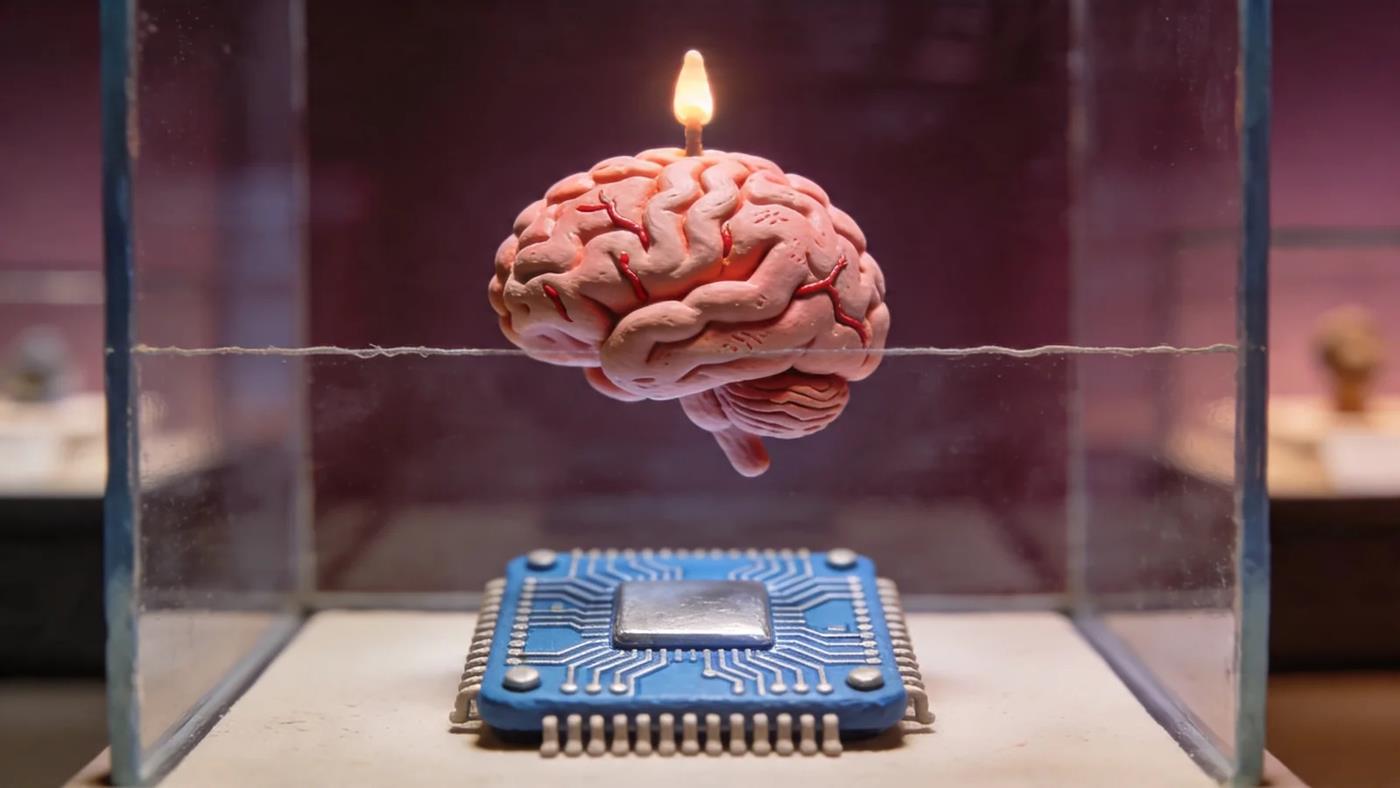

De ce inteligența artificială nu poate fi conștientă?

Un studiu recent afirmă că inteligența artificială nu poate fi conștientă. Această concluzie provoacă discuții în rândul experților din domeniu.

Pe scurt

- Studiul afirmă că „fenomenalul conștiinței” este o stare fizică, nu software.

- Inteligența artificială poate imita comportamente conștiente, dar nu le poate genera.

- Conceptul de „abstraction fallacy” subliniază dependența AI de datele umane.

- Lerchner nu respinge complet posibilitatea dezvoltării inteligenței generale artificiale (AGI).

Studiul recent realizat de cercetătorul Lerchner susține că inteligența artificială (AI) nu poate deveni niciodată conștientă, argumentând că „fenomenalul conștiinței” este o condiție fizică, nu un produs software. Această afirmație contrazice optimismul unor lideri tehnologici, precum CEO-ul DeepMind, Demis Hassabis, care a prezis că AGI va avea un impact mult mai mare decât revoluția industrială.

Lerchner explică faptul că sistemele de inteligență artificială pot simula comportamente conștiente, dar acest lucru nu înseamnă că ele dezvoltă o conștiință reală. Această viziune este susținută de conceptul de „abstraction fallacy”, care sugerează că oamenii organizează datele astfel încât AI să producă rezultate semnificative. Astfel, AI depinde de mintea umană pentru a înțelege și a structura informațiile, ceea ce înseamnă că nu poate genera sensuri proprii.

Ce înseamnă „abstraction fallacy” pentru AI?

Conceptul de „abstraction fallacy” subliniază că inteligența artificială nu are capacitatea de a produce sensuri fără intervenția umană. Aceasta implică faptul că modelele de limbaj mari, utilizate pe scară largă în prezent, funcționează doar ca instrumente care procesează tipare fixe de date. Ele nu au nevoie, nu pot supraviețui sau nu dezvoltă motivații interioare. Această limitare evidențiază natura fundamentală a AI-ului, care este dependentă de datele și interpretările furnizate de oameni.

Ce spun criticii despre aceste concluzii?

Deși mulți academicieni susțin punctul de vedere al lui Lerchner, există și critici care consideră că rezultatele sale nu sunt noi și că argumentele sale au fost discutate de zeci de ani în literatura de specialitate. Unii experți subliniază că studiul nu face suficiente referințe la literatura existentă, ceea ce ridică semne de întrebare cu privire la completitudinea sa.

Este AGI posibilă fără conștiință?

Un aspect interesant al studiului este că Lerchner nu respinge complet posibilitatea dezvoltării AGI. Totuși, el face o distincție importantă, afirmând că, deși AGI ar putea fi dezvoltată, aceasta nu va avea niciodată conștiință. Aceasta sugerează că viitoarele sisteme avansate de AI nu ar trebui considerate „subiecte morale”, ceea ce înseamnă că, chiar și cele mai sofisticate forme de inteligență artificială nu pot revendica drepturi sau conștiință similară cu cea umană.

Întrebări frecvente

Ce afirmă studiul lui Lerchner despre inteligența artificială?

Studiul susține că inteligența artificială nu poate deveni conștientă, deoarece conștiința este o stare fizică, nu un produs software.

Ce este „abstraction fallacy”?

Este un concept care subliniază că AI depinde de interpretările umane pentru a produce rezultate semnificative.

Criticii ce spun despre concluziile lui Lerchner?

Unii critici consideră că rezultatele lui Lerchner nu sunt noi și că argumentele au fost discutate de mult timp în literatura de specialitate.

Este posibilă dezvoltarea AGI fără conștiință?

Lerchner afirmă că AGI ar putea fi dezvoltată, dar nu va avea niciodată conștiință, ceea ce o exclude de la statutul de „subiect moral”.

AI Sesli Okuma

Citire naturală cu voce AI Google WaveNet